-

-

Предмет:

Информатика

-

Автор:

demarionreynolds866

-

Создано:

3 года назад

Знаешь ответ? Добавь его сюда!

-

-

Русский язык10 минут назад

Русский язык 8 класс.

-

Информатика10 минут назад

Информатика!!!!які переходи відносяться до категорії прості?

-

Английский язык10 минут назад

Перепишите пожалуйста этот текст без синтаксических ошибок.

-

ОБЖ10 минут назад

Укажи ряд, утворений назвами продуктів, вживання яких може призвести до харчового отруєння.

Виберіть одну відповідь:

продукти з пошкодженою упаковкою, куплені на стихійних ринках

сир і сметана, куплені у магазині

вагові цукерки, куплене на офіційному базарі м’ясо

зібрані біля магістралі гриби, кефір, куплений у магазині -

Алгебра10 минут назад

Даю 20 балловРешите систему уравнений методом добавления

Информация

Посетители, находящиеся в группе Гости, не могут оставлять комментарии к данной публикации.

How much to ban the user?

1 hour

1 day

Виды информации по форме представления

4.7

Средняя оценка: 4.7

Всего получено оценок: 238.

4.7

Средняя оценка: 4.7

Всего получено оценок: 238.

Любое сообщение можно представить по-разному. Можно написать письмо, нарисовать рисунок, сделать фотографию или снять видеофильм. Информация может быть различных видов в зависимости от того, какой способ выбран для ее представления.

Виды информации по форме представления

Ежедневно люди узнают что-то новое – получают новую информацию. Информация – это знания об окружающем мире. Новые сведения можно получить: из телевизионных передач, из книг, из объяснений учителя на школьных уроках.

Человек может получить знания о любом предмете по-разному: услышать о нем рассказ, увидеть собственными глазами, потрогать и даже понюхать. Поэтому сообщение, которое мы хотим передать кому-либо, можно представить в различном выражении.

Различают следующие виды информации по форме представления:

- Текстовая

- Числовая

- Звуковая

- Графическая

- Видеоинформация

Расскажем кратко о видах информации по форме представления.

Текстовая информация

Текстовая информация – это информация, представленная в форме текстового сообщения, которое написано или напечатано. Здесь кодирование речи выполняется с помощью специальных символов – букв. Закодировать информацию, представив ее в виде текста, можно с помощью алфавитов всех существующих естественных языков, на которых общаются между собой люди.

В каждом языке свой набор букв или специальных знаков – иероглифов. Сначала тексты писали от руки, затем с изобретением книгопечатания, появились печатные тексты.

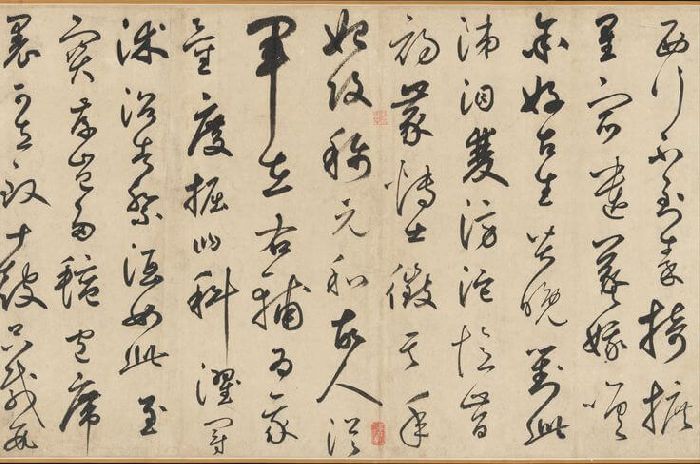

Рис. 1. Китайская каллиграфия.

Числовая информация

Числовая информация – это количественное отображение свойств объектов окружающего мира. Все характеристики объекта, которые можно представить в виде чисел: масса, высота, скорость передвижения – это числовая информация. Существуют различные системы цифр, с помощью которых выражаются количественные характеристики: арабские, римские, клинопись – система знаков в виде клиньев. В памяти компьютера данные также представляются в числовом формате – в виде двоичного кода, который представляет собой набор нулей и единиц. Большое значение числовая форма представления информации приобрела с возникновением товарно-денежных отношений.

Любой текст можно закодировать цифрами, используя специальные системы кодирования, когда каждой букве соответствует определенный набор чисел. Такой способ шифрования называется шифром простой подстановки. Здесь каждой букве ставится в соответствие ее порядковый номер в алфавите языка. Например, А – первая буква алфавита имеет номер 1, Б – 2.

Рис. 2. Двоичный код.

Графическая информация

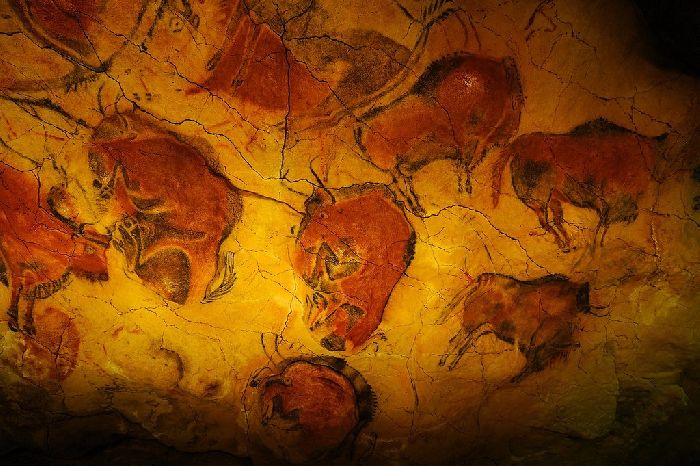

Графическая информация — это информация, представленная в виде картин, чертежей, рисунков, фотографий. Графическая форма дала возможность хранить сведения об окружающем мире. Первые наскальные рисунки древности являются примером такого вида информации. Пещерная живопись является источником ценных сведений для множества научных дисциплин, связанных с изучением древности. На них переданы в виде картинок подробности об истории изучаемой местности.

Известно, что человек воспринимает 80 % информации с помощью органов зрения. Поэтому графическая форма представления так популярна. Как говорится, лучше один раз увидеть, чем сто раз услышать.

По мнению американских ученых, лучше всего запоминается информация, находящаяся в правом верхнем углу области печати и меньше всего схватывается информация из левого нижнего угла.

Звуковая информация

Звуковая информация — это все что можно услышать: музыка, речь человека, шум машин за окном. С древних времен песни и музыкальные произведения передавались из уст в уста, от музыканта к музыканту. Позже придумали способ кодирования музыки с помощью специальных символов – нот.

С появление звукозаписывающих устройств появилась возможность хранения и распространения звуковой информации. Теперь достаточно купить музыкальный диск любимого исполнителя или найти в Интернете понравившуюся композицию.

Видеоинформация

Видеоинформация — это информация, представленная в виде движущихся изображений – фильмов. С появлением в конце 19 века кинематографа появилась возможность сохранения «живых» картин окружающего мира. Кинематограф стал важной частью современной культуры.

Что мы узнали?

Информация – это сведения об окружающем мире, которые могут быть представлены в разном виде. В зависимости от формы представления различают текстовую, числовую, графическую, звуковую и видеоинформацию.

Тест по теме

Доска почёта

Чтобы попасть сюда — пройдите тест.

-

Александра Чугунова

10/10

-

Der-Unsterblicher Stein

10/10

-

Никита Червоненко

9/10

-

Руслан Исламгалиев

8/10

-

Валерия Валерия

8/10

Оценка статьи

4.7

Средняя оценка: 4.7

Всего получено оценок: 238.

А какая ваша оценка?

Информация (от лат. informatio,

разъяснение, изложение, осведомленность)

— любые сведения и данные, отражающие

свойства объектов в природных, социальных

и технических системах и передаваемые

звуковым, графическим (в т. ч. письменным)

или иным способом без применения или с

применением технических средств.

Классификация информации

Информацию можно разделить на виды по

различным критериям:

1. по способу восприятия:

-

Визуальная — воспринимаемая органами

зрения. -

Аудиальная — воспринимаемая органами

слуха. -

Тактильная — воспринимаемая

тактильными

рецепторами. -

Обонятельная — воспринимаемая

обонятельными

рецепторами. -

Вкусовая — воспринимаемая вкусовыми

рецепторами.

2. по форме представления:

-

Текстовая —

передаваемая в виде символов,

предназначенных обозначать лексемы

языка. -

Числовая —

в виде цифр и знаков, обозначающих

математические действия. -

Графическая —

в виде изображений, предметов, графиков. -

Звуковая —

устная или в виде записи и передачи

лексем языка.

3. по назначению:

-

Массовая —

содержит тривиальные сведения и

оперирует набором понятий, понятным

большей части социума. -

Специальная — содержит специфический

набор понятий, при использовании

происходит передача сведений, которые

могут быть не понятны основной массе

социума, но необходимы и понятны в

рамках узкой социальной группы, где

используется данная информация. -

Секретная — передаваемая узкому

кругу лиц и по закрытым (защищённым)

каналам. -

Личная

(приватная) — набор сведений о

какой-либо личности, определяющий

социальное положение и типы социальных

взаимодействий внутри популяции.

4. по значению:

-

Актуальная — информация, ценная в

данный момент времени. -

Достоверная — информация, полученная

без искажений. -

Понятная — информация, выраженная

на языке, понятном тому, кому она

предназначена. -

Полная — информация, достаточная

для принятия правильного решения или

понимания. -

Полезная — полезность информации

определяется субъектом, получившим

информацию в зависимости от объёма

возможностей её использования.

5. по истинности:

-

истинная

-

ложная

Информация обладает следующими свойствами:

-

достоверность

Информация достоверна, если она отражает

истинное положение дел. Недостоверная

информация может привести к неправильному

пониманию или принятию неправильных

решений. Достоверная информация обладает

свойством устаревать, т. е. перестает

отражать истинное положение дел.

-

полнота

Информация полна, если ее достаточно

для понимания и принятия решений.

Как неполная, так и избыточная информация

сдерживает принятие решений или

может повлечь ошибки.

-

точность

Точность информации определяется

степенью ее близости к реальному

состоянию объекта, процесса, явления.

-

ценность

Ценность информации зависит от того,

насколько она важна для решения

задачи, а также от того, насколько в

дальнейшем она найдет применение в

каких-либо видах деятельности человека.

-

своевременность

Только своевременно полученная информация

может принести ожидаемую пользу.

Одинаково нежелательны как преждевременная

подача информации (когда она еще не

может быть усвоена), так и ее задержка.

-

понятность

Если ценная и своевременная информация

выражена непонятным образом, она

может стать бесполезной. Информация

становится понятной, если она выражена

языком, на котором говорят те, кому

предназначена эта информация.

-

доступность

Информация должна преподноситься в

доступной (по уровню восприятия)

форме. Поэтому одни и те же вопросы

по-разному излагаются в школьных

учебниках и научных изданиях.

-

краткость

Информацию по одному и тому же вопросу

можно изложить кратко (сжато, без

несущественных деталей) или пространно

(подробно, многословно). Краткость

информации необходима в справочниках,

энциклопедиях, всевозможных

инструкциях.

Количество информации можно

рассматривать как меру уменьшения

неопределенности знания при получении

информационных сообщений. Это позволяет

количественно измерять информацию.

Существует формула, которая связывает

между собой количество возможных

информационных сообщений N и количество

информации I, которое несет полученное

сообщение: N = 2i (формула

Хартли). Иногда записывается иначе. Так

как наступление каждого из N возможных

событий имеет одинаковую вероятность

p = 1 / N, то N = 1 / p и формула имеет

вид I = log2 (1/p) = — log2

p

Если события неравновероятные, то: hi

= log2 1/pi

= — log2

pi,

где pi — вероятность появления в

сообщении i-го символа алфавита.Удобнее

в качестве меры количества информации

пользоваться не значением hi , а

средним значением количества информации,

приходящейся на один символ алфавита

H = S

pi

hi

= — S pi

log2

pi

Значение Н достигает максимума при

равновероятных событиях, то есть при

равенстве всех pi pi =

1 / N

В этом случае формула Шеннона превращается

в формулу Хартли.

За единицу количества информации

принимается такое количество информации,

которое содержится в информационном

сообщении, уменьшающем неопределенность

знания в два раза. Такая единица названа

битом.

Минимальной единицей измерения количества

информации является бит, а следующей

по величине единицей — байт, причем:

1 байт = 8 битов = 23 битов.

В информатике система образования

кратных единиц измерения несколько

отличается от принятых в большинстве

наук. Традиционные метрические системы

единиц, например Международная система

единиц СИ, в качестве множителей кратных

единиц используют коэффициент 10n,

где n = 3, 6, 9 и т. д., что соответствует

десятичным приставкам «Кило» (103),

«Мега» (106), «Гига» (109)

и т. д.

В компьютере информация кодируется с

помощью двоичной знаковой системы, и

поэтому в кратных единицах измерения

количества информации используется

коэффициент 2n

Так, кратные байту единицы измерения

количества информации вводятся следующим

образом:

1 килобайт (Кбайт) = 210 байт = 1024

байт;

1 мегабайт (Мбайт) = 210 Кбайт = 1024

Кбайт;

1 гигабайт (Гбайт) = 210 Мбайт = 1024

Мбайт.

Количество информации в сообщении.

Сообщение состоит из последовательности

знаков, каждый из которых несет

определенное количество информации.

Если знаки несут одинаковое количество

информации, то количество информации

Ic в сообщении можно подсчитать,

умножив количество информации Iз,

которое несет один знак, на длину кода

(количество знаков в сообщении) К:

Ic = Iз

K

Так, каждая цифра двоичного компьютерного

кода несет информацию в 1 бит. Следовательно,

две цифры несут информацию в 2 бита, три

цифры — в 3 бита и т. д. Количество информации

в битах равно количеству цифр двоичного

компьютерного кода

| Двоичный компьютерный код | 1 | 0 | 1 | 0 | 1 |

| Количество информации | 1 бит | 1 бит | 1 бит | 1 бит | 1 бит |

|

|

Информацио́нная энтропи́я — мера

неопределённости или непредсказуемости

информации,

неопределённость появления какого-либо

символа первичного

алфавита. При отсутствии

информационных потерь численно равна

количеству информации на символ

передаваемого сообщения.

Энтропия — это количество информации,

приходящейся на одно элементарное

сообщение источника, вырабатывающего

статистически независимые сообщения.

Энтропия стала использоваться как мера

полезной информации в процессах передачи

сигналов по проводам. Под информацией

Шеннон понимал сигналы нужные, полезные

для получателя. Неполезные сигналы, с

точки зрения Шеннона, это шум, помехи.

Если сигнал на выходе канала связи

является точной копией сигнала на входе

то, с точки зрения теории информации,

это означает отсутствие энтропии.

Отсутствие шума означает максимум

информации. Взаимосвязь энтропии и

информации нашло отражение в формуле:

H + Y

= 1

где Н – энтропия, Y –

информация. Этот вывод количественно

был обоснован Бриллюэном .

Для расчета энтропии Шеннон предложил

уравнение, напоминающее классическое

выражение энтропии, найденное Больцманом.

H = ∑Pi

log2 1/Pi

= -∑Pi

log2 Pi,

где Н – энтропия Шеннона, Pi

— вероятность некоторого события.

Информационная двоичная энтропия для

независимых случайных событий

![]() с

с

![]() возможными

возможными

состояниями (от

![]() до

до

![]() ,

,

![]() —

—

функция вероятности) рассчитывается

по формуле:

![]()

Эта величина также называется средней

энтропией сообщения. Величина

![]() называется

называется

частной энтропией, характеризующей

только

![]() -e

-e

состояние.

Таким образом, энтропия события

![]() является

является

суммой с противоположным знаком всех

произведений относительных частот

появления события

![]() ,

,

умноженных на их же двоичные

логарифмы. Это определение

для дискретных случайных событий можно

расширить для функции распределения

вероятностей.